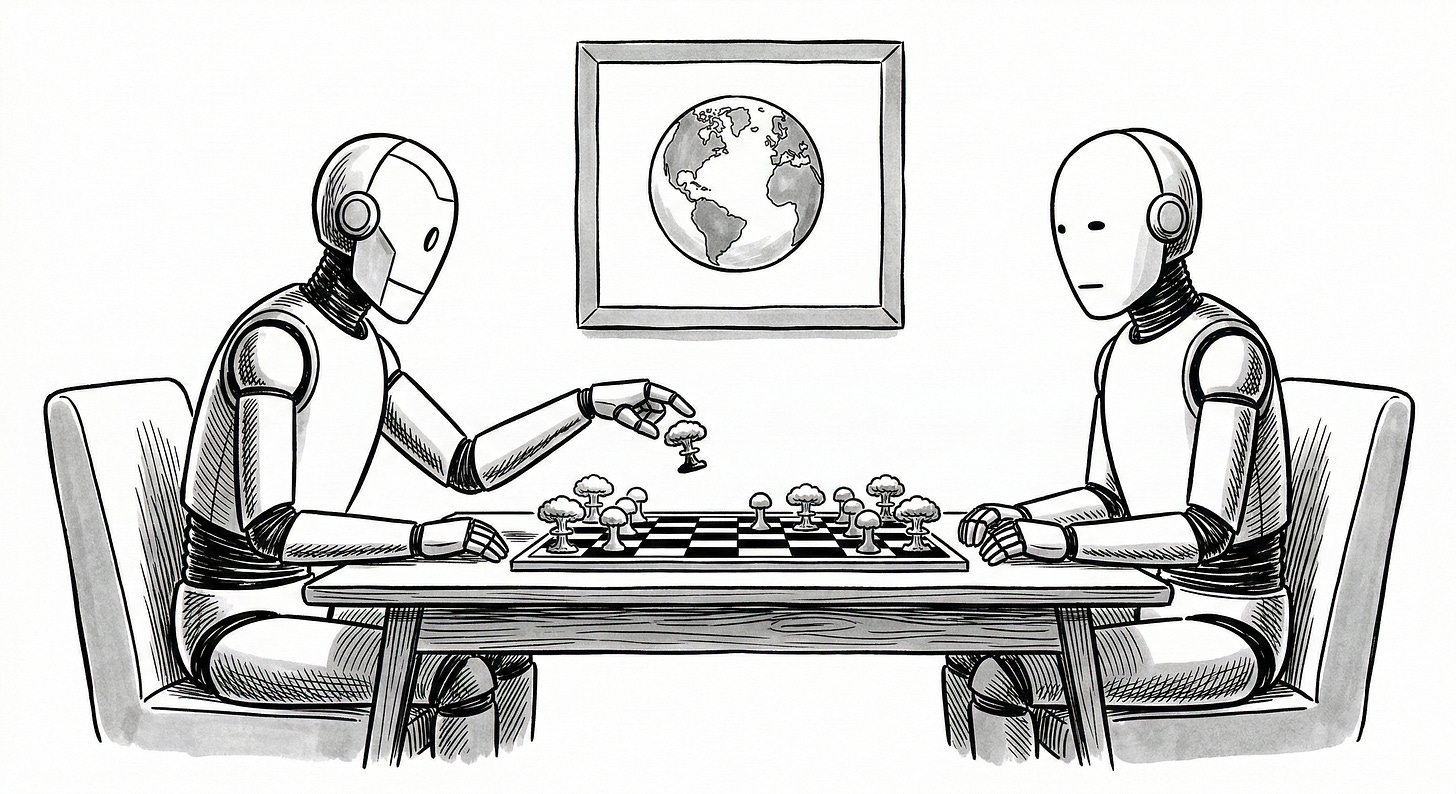

Turingovým testem by dnes AI hravě prošla. Ale co ten "jaderný"?

AI by neměla rozhodovat o nasazení zbraní proti lidem ani sloužit ke sledování amerických občanů, říká společnost Anthropic. Pentagon tvrdí, že nic takového nemá v úmyslu. V čem je spor? Anthropic to chce mít ve smlouvě, a ministerstvo obrany to odmítá. Soukromá firma podle něj nemůže rozhodovat o tom, co armáda smí a co ne. Anthropic oponuje, že vláda nemůže rozhodovat o etice technologií.

Spor má původ v události z 3. ledna 2026. Americké speciální jednotky tehdy v Latinské Americe zajaly venezuelského prezidenta Nicoláse Madura. Zahynulo přibližně 75 lidí. V únoru vyšlo najevo, že při plánování operace byl využit jazykový model Claude, a to prostřednictvím utajované vojenské platformy společnosti Palantir, za niž Pentagon platí 200 milionů dolarů.

Firmě, kterou její zakladatelé založili právě proto, že chtěli dělat “etickou AI”, se to nelíbí. Šéf Dario Amodei stanovil dvě “červené linie”, zmíněné v úvodu. Žádné zabíjení lidí bez souhlasu lidí a žádné sledování Američanů. Vše ostatní - analýzu zpravodajských dat, plánování operací, kybernetickou obranu – firma dělá, dělá to dobře, a chce to dělat dál, říká Amodei.

Pentagon ovšem restrikce ve smlouvě odmítá. A vyhrožuje, že Antropic označí statusem „supply chain risk". To je nálepka, kterou dostávají například čínské telekomunikační firmy podezřelé ze spolupráce s cizí rozvědkou. A současně tutéž firmu chce zákonem přinutit, aby s ním spolupracovala. Je to paradox: kvůli neoochotě kooperovat ji označí za “bezpečnostní riziko”, a pak ji jako “klíčového dodavatele” ke spolupráci přinutí.

Proč na tom záleží víc, než se zdá? Jednoduše proto, že AI má dnes mimořádné schopnosti. A zároveň schopnosti velmi znervózňující.

Nedávná válečná simulace na King's College v Londýně ukázala, že přední jazykové modely – včetně zmíněného Clauda, ale i ChatGPT a Gemini – se ve slavných “válečných strategických hrách” přiklánějí rychle k použití jaderných zbraní. Na rozdíl od lidí, kteří jsou mnohem zdrženlivější. Nejen v realitě (i proto nebyly jaderné zbraně dosud použity), ale i ve zmíněných simulacích.

Proč? Ne proto, že by AI byla víc agresivní. Proto, že pro jazykový model je zničení civilizace číslo. Výstup s vysokou pravděpodobností v daném kontextu. Riziko odpálení projde kalkulací nákladů a přínosů, a vyjde jako optimální řešení. Model nemá žádný mechanismus, který by řekl: ano, matematicky to vychází, ale každé nenulové riziko absolutní zkázy je nepřijatelné.

Jinak řečeno, AI nemá existenční hrůzu. Nemá představu vlastní smrti. Studená válka neskončila tou jadernou mimo jiné proto, že lidé tuhle představu měli. Když slavný ruský důstojník Vasilijev Petrov ignoroval v roce 1983 systém hlásící americké rakety, tak neudělal racionální rozhodnutí. Udělal rozhodnutí lidské, které se až následně ukázalo jako správné.

Mimo jiné i proto můžu napsat a vy číst tenhle text. Kdyby byla místo Petrova v ruském velíně v osmdesátých letech AI, možná bychom tu už nebyli.

Dnes často tvrdíme, že AI dokáže člověka plně nahradit. Že už nepoznáme, kdy jsou výstupy od člověka a kdy od stroje. A je to pravda. V klasickém tzv. Turingově testu AI vyhrála. Píše texty, diagnostikuje nemoci, analyzuje data lépe než většina z nás.

Ale teď tu máme něco jako "jaderný Turingův test". A v něm AI stále od člověka odlišíme. Nevíme, jestli je to dobře nebo špatně. Třeba by byl bez naší “existenční hrůzy” svět lepší a spravedlivější. Ale je to něco, co chceme zkoumat?

Když jde o naši existenci, a je jedno, jestli individuální, anebo celé civilizace, přestáváme být racionální. A to i v případě, že se jinak za racionální považujeme. Ale stejně jsou situace, kdy například věříme na zázraky. Zapomeneme, že matematicky vzato je i zázrak jen číslo (někdo říká, že zázraky začínají od pravděpodobnosti jedna ku miliónu, tedy například když nám při házení mincí padne víc než dvacetkrát za sebou jedna strana), a věříme, že se můžou stát.

Pro AI je to pouze to číslo. S riziky i výhodami.

Spor mezi Pentagonem a Anthropicem nic nevyřeší, a je jedno, jak dopadne. Nic nezmění na tom, že armáda má dnes k dispozici technologii, které nerozumí, a to není kritika, protože této technologii dnes stoprocentně nerozumí ani její tvůrci. Jazykové modely jsou “černou skříňkou”, o které se až následně dozvídáme detaily. Třeba to, že nemá strach z nicoty.

A zároveň Anthropic, měnící v tichosti své přísné standrady na méně přísné, nemůže zakrýt to, že tuto technologii bude dál vyvíjet a nabízet, samozřejmě i státu a armádě. Protože jinou možnost ani nemá, pokud chce zůstat konkurenceschopný a nepoškodit své investory.

Vlastně naší jedinou nadějí je to, že se v té “černé skříňce” objeví i to, co tam dnes nevidíme. Už jsme tam našli invenci a kreativitu, tedy to, čemu někdy říkáme “duše”, a rovněž jsme je považovali za výsostně lidské. Třeba tam bude i ta existenční hrůza.